Introducción

Imagina un futuro en el que una máquina no solo decide si obtienes un préstamo o un trabajo, sino que también determina tu culpabilidad en un tribunal de justicia. En este futuro, la inteligencia artificial (IA) no es solo una herramienta de asistencia, sino una fuerza omnipresente que modela y controla aspectos cruciales de nuestras vidas. Este no es un escenario de ciencia ficción, sino una realidad emergente que ya está comenzando a tomar forma en nuestras sociedades.

La integración de la IA en áreas tan sensibles como el sistema judicial, la selección de personal y la vigilancia masiva está abriendo un campo de debate sobre sus implicaciones éticas. Según un informe del Foro Económico Mundial, el uso de IA en el sistema judicial podría llevar a una justicia sesgada si no se regulan adecuadamente los algoritmos que determinan la culpabilidad (World Economic Forum, 2023). ¿Cómo garantizamos que estas tecnologías no perpetúen prejuicios y discriminaciones? ¿Cómo aseguramos que el poder y la privacidad de los individuos se mantengan intactos en un mundo cada vez más controlado por algoritmos?

La expansión de la inteligencia artificial plantea serios desafíos éticos que deben ser abordados para asegurar un futuro justo y equitativo. En esta era de cambios rápidos, es imperativo cuestionar y entender las implicaciones de estos avances tecnológicos. La IA tiene el potencial de transformar nuestra vida diaria de formas que nunca imaginamos, pero también presenta riesgos que podrían tener consecuencias devastadoras si no se manejan adecuadamente.

Exploraremos cómo la IA está redefiniendo conceptos básicos de privacidad, justicia y equidad, y discutiremos cómo estos cambios podrían afectar nuestra libertad y autonomía en el futuro cercano. Este artículo busca no solo informar, sino también provocar una reflexión crítica sobre el camino que estamos tomando y las decisiones éticas que debemos enfrentar.

Privacidad y Vigilancia

La vigilancia masiva impulsada por IA ha creado un entorno en el que la privacidad personal está constantemente amenazada. Las tecnologías de reconocimiento facial y análisis de datos permiten a los gobiernos y empresas monitorear nuestras actividades en tiempo real. Es como si viviéramos en una casa de vidrio, donde cada movimiento y acción pueden ser observados y registrados sin nuestro conocimiento o consentimiento.

Ejemplo: El uso de cámaras de vigilancia equipadas con IA en ciudades como Londres y Beijing para monitorear y analizar el comportamiento de los ciudadanos ha suscitado preocupaciones sobre la intrusión en la privacidad. Según un estudio de Privacy International (2023), el número de cámaras de vigilancia en Londres ha superado los 600,000, muchas de las cuales están equipadas con tecnología de reconocimiento facial. Esta situación se asemeja a tener un guardia personal invisible siguiendo cada uno de tus pasos, lo que genera una constante sensación de vigilancia.

Preocupaciones:

Intrusión en la Privacidad: El riesgo de que la vigilancia constante pueda violar los derechos de privacidad de los individuos. Imagina tener un diario personal donde registras todos tus pensamientos y acciones, y de repente, ese diario es accesible para cualquier persona sin tu permiso.

Abuso de Poder: La posibilidad de que los datos recopilados sean utilizados para controlar y manipular a la población. Es como si alguien pudiera leer tus mensajes privados y usarlos para chantajearte o manipular tus decisiones.

Bias y Discriminación

Los algoritmos de IA, aunque diseñados para ser imparciales, a menudo perpetúan sesgos preexistentes en los datos con los que son entrenados. Esto puede resultar en decisiones discriminatorias en áreas como la contratación laboral y el sistema judicial. Es similar a juzgar a una persona basada en rumores en lugar de hechos verificables, perpetuando prejuicios sin una base justa.

Ejemplo: El caso de los sistemas de evaluación de currículums como el desarrollado por Amazon, que mostraron un sesgo hacia ciertos géneros y razas debido a los datos históricos sesgados (Dastin, 2018). Esto provocó que Amazon desechara su sistema de contratación automatizado. Es como si un chef usara una receta con ingredientes defectuosos, y el plato resultante fuera inevitablemente malo.

Preocupaciones:

Perpetuación de Injusticias: Cómo los sesgos en los algoritmos pueden amplificar las desigualdades sociales. Es como si un árbitro en un partido de fútbol favoreciera siempre a un equipo, independientemente del desempeño real.

Transparencia en el Desarrollo de IA: La necesidad de que los desarrolladores sean transparentes sobre cómo se entrenan y ajustan los modelos de IA. Es comparable a la necesidad de que las empresas alimentarias revelen todos los ingredientes en sus productos para que los consumidores sepan exactamente qué están consumiendo.

Transparencia y Rendición de Cuentas

La falta de transparencia en los algoritmos de IA y su funcionamiento interno plantea preguntas sobre la rendición de cuentas cuando estos sistemas cometen errores. Es como conducir un coche con el parabrisas empañado: no puedes ver claramente, y cualquier choque es inevitable.

Ejemplo: El uso de IA en decisiones judiciales ha sido cuestionado por su falta de transparencia. Un estudio de ProPublica (2016) mostró que el algoritmo COMPAS, utilizado para predecir la probabilidad de reincidencia de los delincuentes, estaba sesgado en contra de los acusados afroamericanos. Es similar a usar un mapa defectuoso para navegar una ciudad, llevando a rutas incorrectas y decisiones equivocadas.

Preocupaciones:

Opacidad de Algoritmos: Cómo la falta de comprensión sobre el funcionamiento interno de los algoritmos puede afectar la capacidad para cuestionar y corregir errores. Es como si un médico te diagnosticara una enfermedad sin explicar los síntomas o los resultados de las pruebas.

Responsabilidad Legal: Quién es responsable cuando una IA toma una decisión perjudicial o errónea. Es similar a un piloto automático en un avión que toma una decisión incorrecta, pero no hay un piloto humano para corregir el curso.

Impacto Laboral y Económico

La automatización y el uso de IA están transformando el mercado laboral, creando tanto oportunidades como desafíos significativos. Es como una ola tecnológica que puede llevarte a nuevas alturas o derribarte si no estás preparado.

Ejemplo: La automatización de fábricas y el impacto en los trabajos manufacturados tradicionales han llevado a una pérdida significativa de empleos en industrias como la automotriz. Según un informe de McKinsey (2023), hasta el 50% de los trabajos en la manufactura podrían ser automatizados en los próximos años. Es como una gran tormenta que cambia el paisaje, eliminando ciertos trabajos pero también creando nuevos caminos y oportunidades.

Preocupaciones:

Desempleo Tecnológico: El riesgo de que la automatización elimine empleos y exacerbe la desigualdad económica. Es similar a la transición de la agricultura a la industria durante la Revolución Industrial, donde muchos perdieron sus trabajos tradicionales pero se crearon nuevas oportunidades en las fábricas.

Adaptación Laboral: La necesidad de programas de reentrenamiento y adaptación para los trabajadores desplazados por la tecnología. Es como aprender a nadar cuando antes solo sabías caminar: requiere esfuerzo y adaptación, pero te permite seguir avanzando.

Ética de la Creación de IA

La creación de sistemas de IA plantea preguntas éticas sobre el propósito y el control de estas tecnologías. Es como dar vida a una criatura poderosa sin tener un manual de instrucciones claro sobre cómo manejarla.

Ejemplo: El desarrollo de armas autónomas, como los drones de ataque equipados con IA, plantea serias preocupaciones sobre la ética de permitir que las máquinas tomen decisiones letales en conflictos bélicos (Sparrow, 2023). Es similar a permitir que un robot decida quién recibe atención médica en un hospital abarrotado: la vida y la muerte en manos de una máquina.

Preocupaciones:

Decisiones Letales: Las implicaciones éticas de permitir que las máquinas tomen decisiones que pueden resultar en pérdida de vidas. Es comparable a un juego de ajedrez donde cada movimiento incorrecto puede tener consecuencias fatales.

Responsabilidad Moral: La responsabilidad de los desarrolladores y las organizaciones en la creación de tecnologías que puedan ser utilizadas de manera perjudicial. Es como un chef que crea un plato delicioso pero que puede causar alergias graves si no se maneja correctamente.

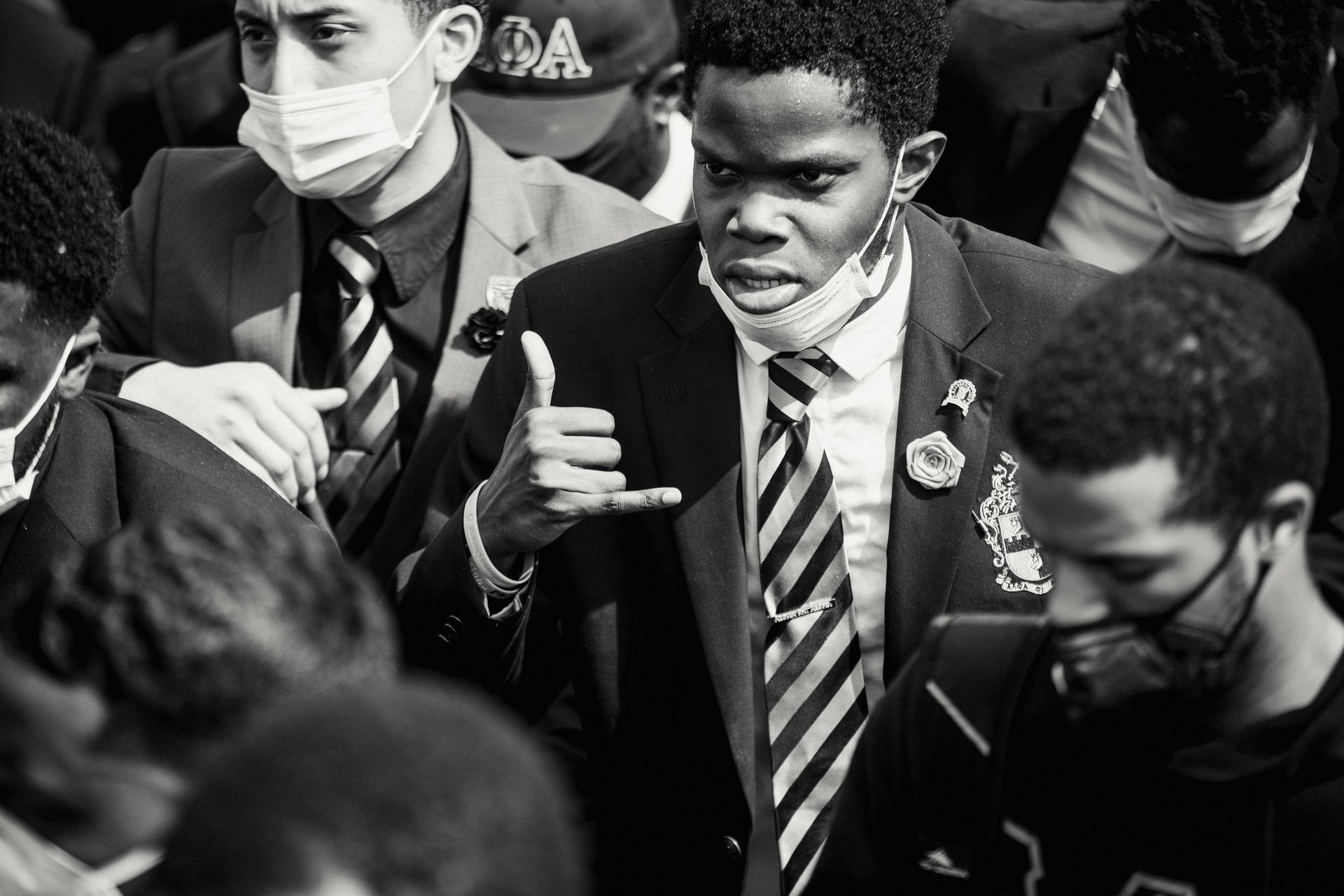

IA y Religión

![]()

La IA está comenzando a influir en la forma en que practicamos y entendemos la religión. Algunas iglesias están utilizando IA para analizar y predecir tendencias en la asistencia a los servicios religiosos. Sin embargo, esto también plantea cuestiones sobre la autenticidad y el propósito de la fe en un mundo donde las máquinas pueden desempeñar roles religiosos.

Ejemplo: En Japón, algunos templos budistas están utilizando robots con IA para realizar rituales y ofrecer sermones, lo que ha generado controversia sobre la autenticidad de estas prácticas (Davis, 2023). Es como reemplazar a un sacerdote o pastor con una grabación: puede entregar el mensaje, pero ¿puede capturar la esencia espiritual?

Preocupaciones:

Autenticidad Espiritual: La posibilidad de que la tecnología disminuya la autenticidad de las prácticas religiosas. Es como si una máquina escribiera una carta de amor: puede tener las palabras correctas, pero carece de la emoción y la sinceridad humana.

Control y Manipulación: El riesgo de que las tecnologías de IA sean utilizadas para manipular las creencias religiosas de las personas. Es similar a un mago que utiliza trucos para engañar al público, pero con consecuencias potencialmente más profundas y personales.

Manipulación Política y Desinformación

La IA está jugando un papel cada vez más importante en la política, desde la microsegmentación de votantes hasta la creación de noticias falsas. Esto puede socavar la confianza en los procesos democráticos y manipular la opinión pública.

Ejemplo: El uso de bots y algoritmos en redes sociales para influir en las elecciones, como se observó en las elecciones presidenciales de 2016 en los EE.UU. (Bradshaw & Howard, 2018). Es como si un grupo de individuos con megáfonos falsos comenzara a gritar información engañosa en una plaza pública, confundiendo a todos los presentes.

Preocupaciones:

Desinformación: El riesgo de que la IA se utilice para difundir información falsa y manipular la opinión pública. Es como un virus que se propaga rápidamente y es difícil de contener.

Erosión de la Democracia: Cómo la manipulación política a través de IA puede socavar la confianza en los procesos democráticos. Es comparable a un juego de cartas donde algunos jugadores hacen trampa, arruinando la experiencia para todos los demás.

IA en la Educación y Medicina

La IA tiene el potencial de revolucionar la educación y la medicina, ofreciendo nuevas formas de aprendizaje y tratamiento personalizado. Sin embargo, también plantea desafíos éticos significativos.

Ejemplo: El uso de IA en la educación para personalizar el aprendizaje y en la medicina para diagnosticar enfermedades de manera más precisa (Topol, 2019). Es como tener un tutor personal para cada estudiante y un médico dedicado a cada paciente, mejorando enormemente la eficiencia y la efectividad.

Preocupaciones:

Acceso Inequitativo: La posibilidad de que solo aquellos con recursos puedan acceder a las mejores tecnologías de IA. Es como si solo algunas personas pudieran asistir a la mejor escuela o recibir el mejor tratamiento médico, creando una brecha aún mayor entre los que tienen y los que no tienen.

Dependencia Tecnológica: El riesgo de volverse excesivamente dependiente de la IA en áreas críticas como la educación y la medicina. Es como confiar tanto en una calculadora que olvidamos cómo hacer cálculos básicos por nosotros mismos.

IA y Evolución

El impacto de la IA en nuestra evolución como especie es un tema de creciente debate. Algunos argumentan que la IA puede ayudar a la humanidad a alcanzar nuevos niveles de progreso, mientras que otros temen que pueda llevarnos a una dependencia peligrosa.

Ejemplo: Los avances en IA podrían llevar a la creación de humanos mejorados con capacidades cognitivas y físicas aumentadas (Kurzweil, 2022). Es como si la humanidad recibiera una actualización de software, mejorando nuestras habilidades y capacidades de maneras inimaginables.

Preocupaciones:

Desigualdad Biológica: La posibilidad de que los avances en IA y biotecnología creen una brecha entre los humanos mejorados y los no mejorados. Es como si algunas personas pudieran correr más rápido o pensar más claramente gracias a una actualización tecnológica, dejando atrás a aquellos que no tienen acceso a esas mejoras.

Identidad y Humanidad: Cómo la integración de la IA en nuestras vidas puede afectar nuestra identidad y sentido de humanidad. Es similar a un barco que se convierte gradualmente en una máquina, planteando la pregunta: ¿cuándo deja de ser un barco y se convierte en otra cosa?

Conclusión

A medida que avanzamos hacia un futuro cada vez más dominado por la inteligencia artificial, es esencial que enfrentemos y abordemos estos desafíos éticos de manera proactiva. La IA tiene el potencial de transformar nuestras vidas de formas profundas y duraderas, pero solo si navegamos cuidadosamente las aguas turbulentas de la ética y la equidad.

La transparencia y la responsabilidad deben ser los pilares sobre los cuales construimos el futuro de la IA. Necesitamos políticas y regulaciones claras que aseguren que estas tecnologías se desarrollen y utilicen de manera justa y equitativa. También debemos fomentar una cultura de responsabilidad ética entre los desarrolladores y las organizaciones que crean e implementan IA.

En última instancia, la pregunta que debemos hacernos no es solo qué puede hacer la IA, sino qué debe hacer la IA. Al abordar estos desafíos éticos de frente, podemos trabajar juntos para crear un futuro en el que la tecnología realmente beneficie a toda la humanidad.

Invitación a los Lectores

Te invitamos a compartir tus opiniones sobre los desafíos éticos de la inteligencia artificial. ¿Qué piensas sobre el impacto de la IA en la privacidad, el sesgo y el trabajo? ¡Comenta abajo y comparte este artículo en tus redes sociales para que más personas se unan a la conversación!

Fuentes

- Dastin, J. (2018). Amazon Scraps Secret AI Recruiting Tool That Showed Bias Against Women. Reuters. Retrieved from reuters.com

- Sparrow, R. (2023). Killer Robots. Journal of Applied Philosophy, 40(1), 18-36. Retrieved from ethicsandinternationalaffairs.com

- Topol, E. (2022). Deep Medicine: How Artificial Intelligence Can Make Healthcare Human Again. Basic Books. https://psnet.ahrq.gov/issue/deep-medicine-how-artificial-intelligence-can-make-healthcare-human-again

- World Economic Forum. (2023). The Impact of Artificial Intelligence on the Justice System. Retrieved from weforum.org

- ProPublica. (2016). Machine Bias. Retrieved from propublica.org

- University of Oxford. (2022). Computational Propaganda Research Project. Retrieved from https://www.oii.ox.ac.uk/research/projects/computational-propaganda/

- Privacy International. (2023). The State of Surveillance in London. Retrieved from privacyinternational.org

- McKinsey & Company. (2023). The Future of Work: Automation, Employment, and Productivity. Retrieved from https://www.mckinsey.com/featured-insights/future-of-work

- UNESCO. (2023). Artificial Intelligence in Education: Challenges and Opportunities. Retrieved from https://www.unesco.org/en/articles/challenges-and-opportunities-artificial-intelligence-education

Desafíos Éticos de la Inteligencia Artificial: Privacidad, Sesgo y Futuro Tecnológico